「加三嘻行動哇 Yipee! 成為好友」

【Facebook、Youtube、Twitter、Instagram、Telegram、Line】

Apple 表示「保護兒童」是一項重要責任,因此將針對 iPhone、iPad 和 Mac 加入新功能,包括在 iMessage 訊息加入安全功能、在 iCloud 檢測兒童性虐待材料 (Child Sexual Abuse Material, CSAM) 內容,以及 Siri 和搜尋的更新警示。

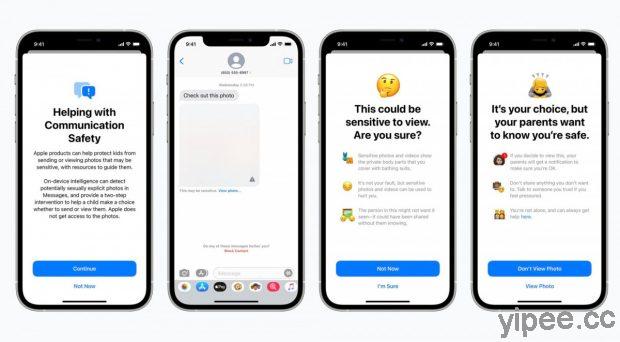

iMessage 阻擋兒童色情內容

Apple 針對 iMessage 打造安全功能,當 iCloud 家庭中的孩子收到或嘗試發送色情照片時,就會收到一則警告訊息。

首先,iMessage 會使用裝置上的機器學習功能,對任何敏感內容發出警告,當中會保障使用者的隱私,就連 Apple 也不會得知。

Apple 解釋說,當孩子收到色情圖片時,圖片「自動模糊化」,並且 iMessages 會顯示警告訊息,表示圖片內容敏感。如果孩子點擊「瀏覽照片」,就會收到提醒訊息,說明為什麼這照片被認為是敏感的。

但是當孩子如果想試圖發送情色照片時,就會收到警告通知,並且當孩子選擇發送照片時,父母也會收到通知訊息,適用於 13 歲以下的孩子。

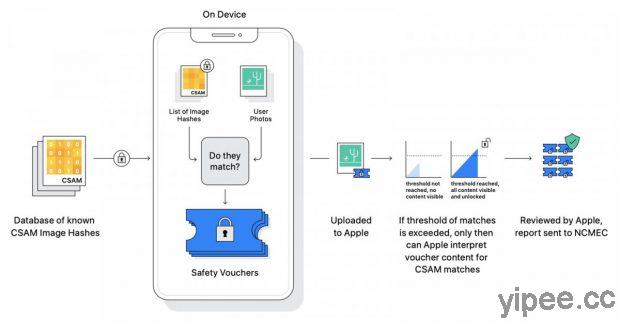

iCloud 照片加入 CSAM 兒童色情偵測

Apple 宣布將在 iOS 、 iPadOS 使用新技術,打擊與阻擋 CSAM 兒童色情內容傳播。

Apple 將會針對 iCloud 的照片進行偵測,發現 CSAM 照片時,Apple 會將資料提供給美國國家兒童失蹤與受虐兒童援助中心,這些機構經過研究之後,會將 CSAM 照片的綜合報告給執法部門合作。

Apple 強調偵測 CSAM 照片時會考慮到使用者的隱私,基本上是以照片是否與美國國家兒童失蹤與受虐兒童援助中心的圖像資料庫吻合。重點是 Apple 只會分析放在 iCloud 雲端的照片,儲存在本機相簿的照片不會經過檢測過程。

Apple 蘋果表示,這項功能將先在美國推出,未來希望能拓展到其他市場。

Siri 與搜尋功能升級

除了 iCloud 照片和 iMessage 加入 CSAM 兒童色情檢測之外,Apple 針對 Siri 和搜尋功能進行升級。

Apple 還會透過更多資源來幫助兒童和父母維護網路安全,並在適當時候進行干預。提醒使用者搜尋內容是有害的和有問題的,同時提供資源給予協助。

延伸閱讀:

Apple 蘋果釋出 iOS 15 和 iPadOS 15 Public Beta 公開測試版,非開發者也能體驗最新系統!

iOS 15 App 退款將不麻煩!可直接在 App 內申請退款

Apple iOS 15 新增「Digital Legacy」計畫, 使用者可決定死後有誰可以碰 Apple ID 資料

【教學】如何使用 MAC 電腦加密外接硬碟或隨身碟的資料,保障資料安全性不外洩!

iPhone 和 iPad 的 Google地圖終於也有黑暗模式了,還能透過 iMessage 分享位置!

【教學】找不到 Android 手機、忘記密碼或手機不見,怎麼辦?「尋找我的裝置」

圖片及資料來源:9to5Mac

|

|